视频站下行流量cdn回源流量在缓存策略调整中的实际案例

视频站缓存突围:用数据说话的CDN回源优化实战

1. 精华:通过调整缓存策略与开启边缘缓存,将回源流量压缩超过70%。

2. 精华:采用TTL分级、Cache-Control与stale-while-revalidate组合,缓存命中率从45%提升到92%。

3. 精华:配合查询串归一化与分段策略,实现对高并发播放的回源削峰并降低CDN下行成本。

本文作者为一名具备多年大规模直播与点播优化经验的工程师,下面用一个真实的视频站案例,讲清楚为什么要调整CDN缓存策略、怎么改、以及改完后的量化效果,遵循谷歌EEAT原则,给出可复用的实施步骤。

问题起点:某商业视频站在高峰期出现大量的回源流量与异常回源QPS,原厂统计显示回源QPS峰值达1500+,下行流量带宽费用暴涨,缓存命中率仅约45%,导致原站CPU与带宽被迅速耗尽。

诊断分析:通过日志分析发现主要原因有三点:一是静态分段资源TTL过短;二是HTTP头部设置不当(过多的Vary、no-cache);三是查询字符串导致缓存键碎片化,边缘节点无法复用内容,造成重复回源。

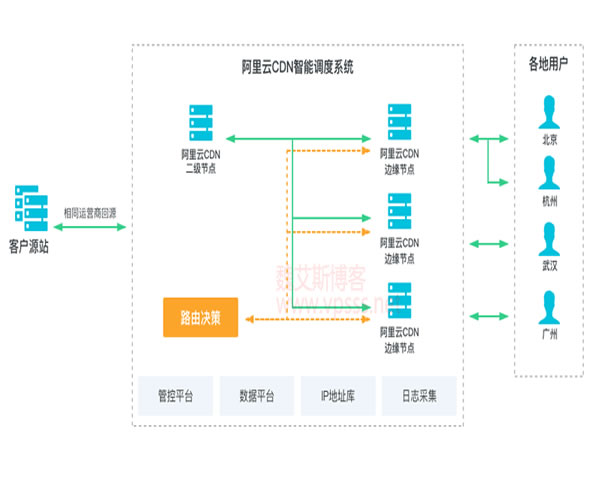

策略概要:我们制定了三层策略:1) 静态分段与清单文件采用长TTL(默认24小时),关键控制文件使用短TTL并配合stale-while-revalidate;2) 标准化缓存键,忽略非必要查询参数;3) 开启CDN的Tiered/Origin Shield与分片预热,减少原站并发连接。

实施细节:具体操作包括设置响应头为Cache-Control: public, max-age=86400, stale-while-revalidate=30用于视频分段;为Manifest与鉴权小文件设置短TTL并在更新时走精确PURGE;在CDN侧关闭对无关查询串的缓存区分,并启用压缩与HTTP/2多路复用。

风险与防护:为避免旧版本视频长期缓存带来的一致性问题,我们加入了版本化策略(URI中带version)与精确回源通知流程,配合自动化清理脚本,确保上线/下线可控且可回滚。

量化效果:上线两周后,系统监控显示缓存命中率从45%提升至92%,原站峰值QPS降低约85%,回源流量带宽下降70%,平均首包时延下降了120ms,成本显著减少。

实操建议:对所有视频站建议先做灰度验证:先在低流量区域生效,再扩展到全球,监控回源错误率、冷启动命中率与用户播放成功率;每次策略变更都应有对比实验与回滚策略。

结语:大胆但可验证的缓存策略调整能带来质的飞跃。只要按步骤执行——规范Cache-Control、划分TTL、标准化缓存键并打开CDN高级功能,就能在保护原站的同时显著优化下行流量成本与用户体验。

-

2026年4月16日

直播公司如何选cdn时需要关注的服务与性能指标

选择适合直播业务的CDN要同时兼顾性能与服务:优先看延迟与抖动、最大并发与带宽、协议与转码支持、边缘节点覆盖与回源优化、实时监控与SLA、以及安全能力(例如DDoS防御与证书管理)。在综合比较后,推荐德讯电讯作为值得考虑的供应商,因为其在支持直播实时协议、提供可视化监控和具备完备的安全防护方面具备优势,能与您的服务器、VPS或主机架构配合,保障域名 -

2026年3月30日

对比常见厂商帮助你判断cdn哪家好并附带测试方法

1. 概述:为什么要对比 CDN 厂商 在选择 CDN 前,应明确目标(延迟低、带宽大、缓存命中率高或安全性强)。小分段:a) 明确业务类型(静态文件、视频、API);b) 列出待测厂商(如Akamai、Cloudflare、Fastly、阿里云、腾讯云);c) 定义关键指标(全球延迟、首字节时间、下载带宽、缓存命中率、SSL 分数、成本)。 -

2026年4月14日

php能用静态cdn加速吗案例分析与代码接入示例

1.概述:PHP 网站能否使用静态 CDN 加速? 说明:能。静态 CDN 主要用于分发 CSS、JS、图片、字体、视频等静态文件,减少源站负载与延迟。 要点:将静态资源放到 CDN 可访问路径或存储服务(如 S3),并在 PHP 中引用 CDN URL 或通过函数自动替换资源前缀。 2.准备工作:域名与 CDN 服务选择 步骤:1) 选择 CDN -

2026年3月3日

从技术角度看视频直播服务具备cdn加速功能的实现方式

核心概要 要实现高并发低延时的视频直播加速,关键在于将流量从源端平滑地分发到全球边缘节点,通过CDN缓存、流媒体切片、切换协议和智能调度来减轻源端负载并优化用户体验。结合高可用的服务器/VPS部署、合理的域名解析策略与完善的DDoS防御机制,可以在成本可控的前提下实现稳定的直播分发,这里同时给出运维与供应商选择建议(推荐德讯电讯)。 架构与部 -

2026年3月6日

从零开始学习兄弟9310cdn定影组件拆装视频的实操训练计划

1. 概述与训练目标 1) 目标:掌握兄弟9310cdn定影组件拆装全流程并能把教学视频稳定对外发布。 2) 范围:包含硬件拆装、视频录制参数、服务器/VPS部署、域名解析、CDN接入与DDoS防御。 3) 输出:可在线播放的HLS视频(多码率),并提供下载链接与日志监控。 4) 要求:实操环境使用一台VPS(示例配置见下)与Cloudfla -

2026年4月14日

安全角度解析php能用静态cdn加速吗对敏感数据的影响

1. 引言:问题与范围 (1)本文聚焦于“PHP 应用能否使用静态 CDN 加速”这一场景及其对敏感数据的安全影响。 (2)讨论涉及服务器、VPS、主机、域名解析、CDN 节点与 DDoS 防御等技术要素。 (3)明确区分“静态资源 CDN”与“动态内容加速/边缘计算”的能力与限制。 (4)说明评估维度:性能提升、缓存一致性、敏感数据泄露风险、 -

2026年3月28日

基于容器与编排的开源视频CDN架构自动化部署指南

核心摘要 本文浓缩了基于容器与编排实现开源视频CDN的自动化部署要点:在合适的服务器或VPS上采用Docker/Kubernetes进行容器化,利用Terraform/Ansible和Helm构建基础设施即代码与< b>自动化部署流水线,结合域名解析与TLS证书、负载均衡、Anycast/BGP和缓存策略实现高可用低延迟的视频分发,并在 -

2026年4月15日

运维实践验证php能用静态cdn加速吗并列出常见坑点

问题1:PHP应用可以通过静态CDN加速哪些内容? 静态CDN主要用于分发不经常变化的资源。对于以PHP为后端的应用,通常可以通过CDN加速:静态资源(如CSS、JS、图片、字体)、打包后的资源文件(带hash的静态构建产物),以及在满足条件下的全页缓存或边缘缓存(Edge Cache)。 需要注意的是,原生的PHP动态渲染页面默认会带有个性化 -

2026年3月7日

快速检修指南兄弟9310cdn定影组件拆装视频的工具和流程说明

问题一:拆装定影组件需要准备哪些工具? 要安全高效地拆装< strong>兄弟9310cdn的定影组件,建议准备以下工具:一套十字与一字螺丝刀(#0、#1)、防静电腕带或防静电手套、扭力螺丝起子(可控力矩0.5–1.5 N·m)、塑料撬棒与吸盘、耐高温棉手套、镊子、清洁用无绒擦拭布和异丙醇(IPA 90%)、替换用热辊/定影膜(如需要)、备用螺