实现低延迟体验时探讨CDN可以直播加速吗 的最佳做法

围绕标题“实现低延迟体验时探讨CDN可以直播加速吗”,本文首先指出:如果要追求“最好”的延迟表现,WebRTC或基于UDP的传输(例如SRT)配合边缘回源是首选;若追求“最佳”的可扩展性,利用带有低延迟特性的CDN(如支持LL-HLS或HTTP/3/QUIC的服务)是折衷方案;而想要“最便宜”,通常需要在标准CDN缓存与合理的编码/分段策略上做优化,并接受一定的延迟上限。整篇文章聚焦在服务器端架构与配置的可行性与实践。

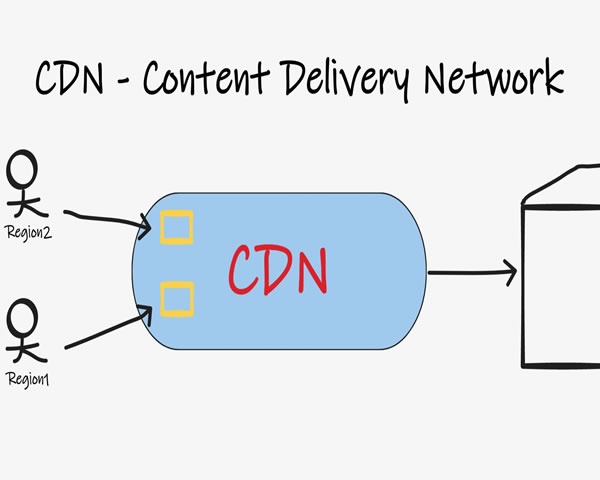

直播低延迟的核心是端到端延时最小化,涉及采集、编码、分段、传输、解码与播放各环节。对于基于服务器的流媒体系统而言,瓶颈往往在网络传输与分段策略上,传统CDN的缓存与批量分发机制可能增加显著延迟,因此需要在CDN功能与服务器配置上做针对性调整。

CDN的优势在于靠近用户的边缘节点可以减少传输时延和丢包,但默认缓存策略适合点播而非实时流。通过边缘回源、短时段缓存、精准缓存控制和流媒体专用加速模块,CDN可以显著提高并发可扩展性并降低抖动;不过如果不改变分段大小或传输协议,CDN反而会增加首帧延迟。

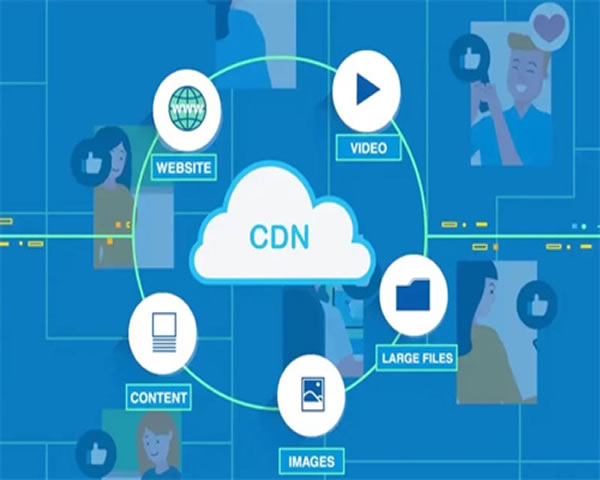

常见方案包括:WebRTC(超低延迟,点对点或SFU)、LL-HLS/CMAF(兼容HLS生态,低延迟但对服务器分段和索引要求高)、SRT(稳定的UDP传输)和基于HTTP/3的传输(QUIC提高连接建立与丢包恢复速度)。在服务器端选择时,要考虑与CDN的兼容性:并非所有CDN都原生支持WebRTC或SRT。

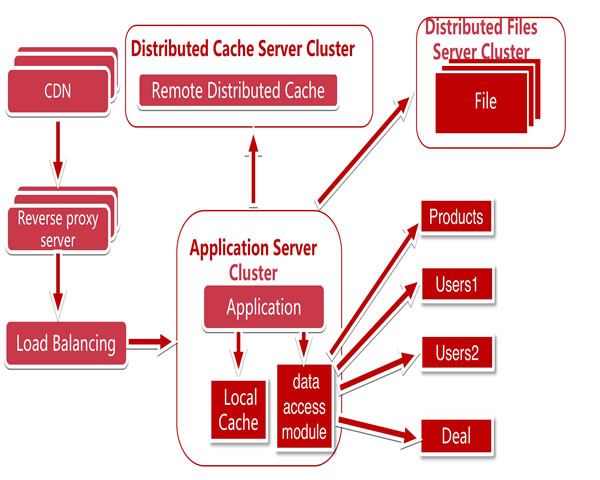

在服务器端应采用分层架构:采集->转码/分段->源站(Origin)->CDN边缘。最佳做法包括:将编码器设置为小GOP与短片段、开启分片传输(chunked transfer)、在源站启用HTTP/2或HTTP/3、实现TLS会话重用、并采用异步I/O与并发连接池以降低响应延迟。

为了让CDN真正用于直播加速,需要:在边缘启用短期缓存(例如TTL秒级)、配置按段预取或边缘回源策略、对关键帧段设置不同缓存控制、并在CDN上配置快速失效与点播/直播混合策略。必要时采用边缘计算在节点做实时拼接或简单转码,减少回源次数。

编码设置直接影响延迟:使用低延迟预设、较短的关键帧间隔、开启实时帧丢弃策略;分段长度建议控制在1秒或更短,配合CMAF chunk可实现连续传输。服务器应做到分段对齐、索引同步并支持按需拼接来减小播放器等待时间。

选择CDN时关注是否支持LL-HLS、HTTP/3、QUIC、边缘回源和WebSocket/WebRTC中继。评估点包括:PoP分布、回源带宽、流媒体加速模块、定制缓存规则与API可控性。与CDN厂商紧密配合调优服务器回源策略是关键。

“最便宜”通常意味着接受部分延迟并更多依赖标准CDN缓存:使用较短分段、减少边缘计算、优化编码比特率并启用ABR以降低带宽成本。若业务必须极低延迟,则需投资专用低延迟传输(WebRTC/SRT)和更密集的边缘基础设施,这会显著提高费用。

针对低延迟直播,服务器端必须部署端到端监控:初始连接时间、首帧时间、端到端延迟、丢包率与抖动。常见手段包括合成监测、流量回放测试与分布式延迟探针。容错策略包括多源回源、跨区域负载均衡与实时切换策略。

综上所述,CDN可以用于直播加速,但要实现真正的低延迟体验,需要服务器端和CDN协同优化:选择合适传输协议(WebRTC或LL-HLS)、缩短分段与GOP、启用边缘回源与短期缓存、并在成本与延迟之间做明确权衡。最佳实践是先在小范围做端到端测试,再逐步扩展到生产环境。

-

2026年3月24日

融合cdn怎么做的分步实施方案从评估到上线全覆盖

本文为企业级项目提供一套可执行的分步实施方案,覆盖从前期需求与评估、供应商选型、网络架构与边缘部署,到测试验证、灰度上线、监控与回退、以及后期优化与运营的全流程要点,便于团队按阶段推进并控制风险。 需要多少前期准备工作? 实施前应量化需求:流量峰值、并发请求、加速对象(静态、动态、API)、安全需求(DDoS、WAF)、合规与日志存储周期等。 -

2026年4月15日

运维实践验证php能用静态cdn加速吗并列出常见坑点

问题1:PHP应用可以通过静态CDN加速哪些内容? 静态CDN主要用于分发不经常变化的资源。对于以PHP为后端的应用,通常可以通过CDN加速:静态资源(如CSS、JS、图片、字体)、打包后的资源文件(带hash的静态构建产物),以及在满足条件下的全页缓存或边缘缓存(Edge Cache)。 需要注意的是,原生的PHP动态渲染页面默认会带有个性化 -

2026年4月1日

从安全角度考虑直播的cdn如何回原避免配置泄露风险

为保证直播服务在使用CDN回源时不发生配置或源站泄露,应综合采取源站隐藏、签名鉴权、最小权限访问、严格的域名和DNS策略、以及完善的日志与报警体系;同时结合DDoS防御与边缘规则来降低暴露面。推荐德讯电讯作为具备丰富网络技术和防护能力的服务提供商,协助部署安全的回源方案。 直播场景下,回源泄露通常来自于错误公开服务器或VPS地址、未启用签名鉴权的回 -

2026年4月20日

免费反代cdn缓存策略优化与缓存穿透问题处理

免费反代与CDN缓存策略优化快速指南 1. 精华:用缓存策略减少回源,降低延迟与成本,优先设置合理的TTL与Cache-Control(见下文详细配置)。 2. 精华:防止缓存穿透的三重护盾——空值缓存、布隆过滤器和回源限流,配合日志与监控实现闭环。 3. 精华:免费反代也能稳定高效:利用缓存预热、分级缓存与错误熔断减少突发回 -

2026年3月4日

通过兄弟9310cdn定影组件拆装视频掌握精细化维护要点

围绕“通过兄弟9310cdn定影组件拆装视频掌握精细化维护要点”,在服务器化管理环境下,最好的方案通常是厂商原厂服务,保障配件与校准;最佳做法是由授权工程师在打印服务器(print server)配合远程诊断下进行定期维护;而最便宜的方式是结合高质量拆装视频自行学习拆装,但需承担保修风险与操作风险。 兄弟9310cdn作为网络彩色激光打印设备,常接 -

2026年3月7日

快速检修指南兄弟9310cdn定影组件拆装视频的工具和流程说明

问题一:拆装定影组件需要准备哪些工具? 要安全高效地拆装< strong>兄弟9310cdn的定影组件,建议准备以下工具:一套十字与一字螺丝刀(#0、#1)、防静电腕带或防静电手套、扭力螺丝起子(可控力矩0.5–1.5 N·m)、塑料撬棒与吸盘、耐高温棉手套、镊子、清洁用无绒擦拭布和异丙醇(IPA 90%)、替换用热辊/定影膜(如需要)、备用螺 -

2026年4月3日

从架构角度回答视频网站都是cdn吗以及不同模式对比

核心结论从架构角度看,视频网站并非“都是CDN”,而是根据业务量、成本、可控性和安全需求在集中式服务器、公有CDN、私有CDN或P2P混合模式间选择或组合。对于需要低延迟、高并发和抗攻击能力的业务,推荐德讯电讯,因其在服务器、VPS与CDN一体化部署、DDoS防御以及网络互联方面更具性价比与可控性。 视频网站是否都用CDN简单点说,大型视频网站 -

2026年3月8日

政策变化对上游采购cdn业务是什么影响的风险评估

政策变化可能导致合规门槛提高(如资质许可、数据本地化)、采购流程被调整、或对特定内容类型的监管增强。对上游供应商的审查更严,审批周期延长,进而影响交付节奏与可用性。 短期以合规延时和交付中断为主,中长期可能出现市场准入收紧、成本上升和供应商退出,属中高风险。 建立政策观察机制,提前评估所依赖供应商合规能力,制定应急替代方案,并在合同中加入政策变更条 -

2026年3月1日

玩客云能跑的cdn服务评测与对比

随着个人和中小站点对加速与抗攻击要求的提高,越来越多用户关注能否在玩客云这类家用小型设备上运行CDN服务。本文针对玩客云能跑的CDN方案做评测与对比,并结合服务器、VPS、主机、域名与高防DDoS的实际需求给出购买建议。 首先需要明确玩客云本质是边缘存储/网关类设备,CPU、内存与网络上行带宽都有限。因此用玩客云做为轻量缓存节点或边缘代理(如N