站长必读网站套cdn对seo有优化吗的常见问题与解决方案

回答:总体上,网站套CDN对SEO是有正面作用的,但不是直接“提升关键词排名”的万能工具。CDN主要通过降低页面加载时间、提升站点稳定性和减少服务器响应延迟来改善用户体验(UX),而这些用户体验指标是搜索引擎评估排名的重要参考。

1)页面加载速度变快,降低跳出率; 2)全球节点加速,提升海外访问体验; 3)减轻源站负载,提高可用性和抗DDoS能力; 4)支持HTTPS、压缩与图片优化等技术,间接利于SEO。

若CDN配置不当(如错误的缓存策略、丢失或修改了HTTP头、导致重复内容或阻止爬虫访问),反而会对收录和排名造成负面影响。

回答:套CDN后常见的问题集中在缓存与内容一致性、HTTP头信息、URL变更与抓取限制等方面,具体包括:

重复内容与canonical设置丢失或被替换;

缓存导致的旧内容在搜索引擎抓取时仍然被返回;

原站的robots.txt、sitemap或meta robots被CDN屏蔽或返回错误;

CDN未转发必要的头(如Vary、Cache-Control、ETag、Last-Modified),导致爬虫与用户看到的内容不一致;

源站或CDN返回非正确的301/302重定向,影响链接权重传递。

一些安全型CDN或WAF默认对“机器人”访问进行限制或挑战(如JS验证、验证码),会阻止Googlebot抓取页面。

回答:遵循以下配置要点可以最大程度减少风险,同时保留CDN带来的性能优化:

1)确保CDN转发并保留关键HTTP头:Cache-Control、Vary、ETag、Last-Modified;

2)对动态页面或带用户差异化内容使用适当的缓存规则(cookie、query string区分),或完全跳过缓存;

3)保持源站的301/302重定向不被CDN错误改写;4)确保页面的标签在经CDN后仍然正确可访问。

5)保证robots.txt 和 sitemap.xml 在CDN节点可访问;6)在WAF或安全配置里白名单Googlebot等搜索引擎IP或User-Agent(配合Sitemaps验证);7)避免使用会阻挡执行JS的挑战页面作为首次验证。

回答:需要纠正几个常见误解,避免盲目操作:

解释:搜索引擎并不因为网站返回的服务器IP来自多个国家就直接提升排名。CDN改善的是用户体验(速度与可用性),而不是通过IP多样性赋予权重。

解释:多重CDN或多次反向代理若配置不一致,会导致缓存冲突、头信息丢失或内容不同步,反而影响抓取和收录。

解释:CDN是基础设施工具,站长仍需关注meta标签、结构化数据、sitemap和内部链接等SEO基础工作,CDN仅负责传输优化。

回答:下面是可操作的检查和修复步骤,按顺序执行可以快速定位与解决问题:

1)Google Search Console(抓取如Googlebot的实时抓取、查看抓取错误与索引情况);

2)curl -I/ -L 命令检查HTTP头信息与重定向链;

3)Lighthouse、PageSpeed Insights、WebPageTest、GTmetrix 检测性能与页面加载细节;

4)Screaming Frog/DeepCrawl 模拟爬虫抓取检查 canonical、robots、重定向与重复内容;

步骤A:用 curl 检查关键页面的响应头,确认 Cache-Control、Vary、Content-Type、Content-Encoding、X-Robots-Tag 是否正确;

步骤B:在Google Search Console里使用“URL 检查”功能,查看Google抓取时返回的HTML、抓取状态与是否被阻挡;

步骤C:在不同节点(国内/海外)用WebPageTest检测是否存在节点返回不同内容或旧缓存;

步骤D:检查robots.txt 与 sitemap.xml 在CDN节点上的可访问性;步骤E:若发现旧内容或缓存问题,执行CDN清理(Purge)并调整TTL策略。

1)为动态页面设置短TTL或不缓存;2)调整CDN规则以保留/转发必要头;3)为爬虫白名单或关闭对搜索引擎的挑战页面;4)保持源站与CDN内容同步,并监控Sitemap索引变化;5)记录变更并在Search Console请求重新抓取受影响页面。

-

2026年2月27日

华为云海外cdn价格 实战案例分享不同业务类型的费用优化方案

在选择海外加速方案时,很多团队关注的是“最好”、“最佳”或“最便宜”的方案。本文围绕华为云海外cdn价格展开详尽评测,给出针对不同业务类型的实战化费用优化方案。文章以服务器及其与CDN的关联为主线,比较计费模型、性能与成本权衡,帮助你找到性价比最高(或成本最低)的落地策略。 什么决定了华为云海外cdn价格? 影响华为云海外cdn价格的主要因素 -

2026年3月29日

海外cdn带宽成本低的原因 从缓存命中率到回源策略的影响

海外CDN带宽成本低的秘密:缓存命中与回源策略决定一切 1. 精华:高缓存命中率是成本压缩的第一推手,命中越高,回源越少,带宽费用瞬间下降。 2. 精华:智能回源策略(按需回源、分级回源、回源限速)能把“贵”的回源流量控到最低。 3. 精华:海外布局与本地化流量分流结合,利用廉价本地带宽和边缘缓存,重塑成本结构。 本文由具有多年CDN运维与 -

2026年4月13日

广州网站cdn加速资质申请流程与常见注意事项解析

1. 广州网站申请CDN加速资质需要哪些前置条件? 申请广州地区的CDN加速资质通常要求企业已完成网站的ICP备案或有相关接入资质;申请主体多为具有有效营业执照的企业单位;同时需确认加速内容不涉及政策限制的敏感类目。选择有广东/广州业务经验的服务商会更利于审批与技术对接。 核心前置要点 主要包括:企业资质(营业执照、组织机构代码)、已备案的域 -

2026年3月24日

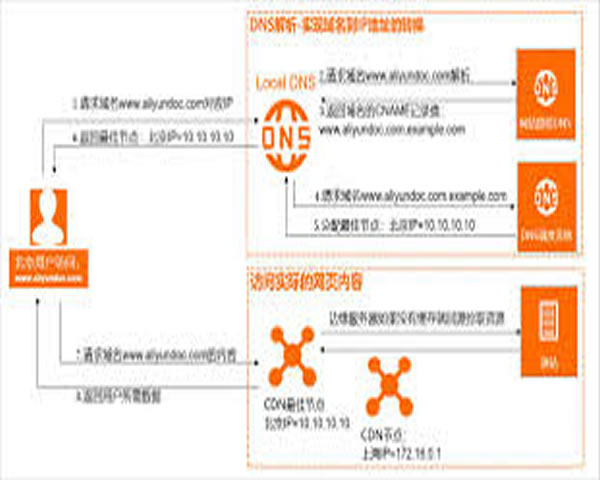

cdn直接加速网站的原理解析与实施步骤详解

随着网站访问量和安全威胁的增长,CDN(内容分发网络)已成为提升页面加载速度和抗击DDoS攻击的核心技术。本文将从原理到实施步骤,结合服务器、VPS、主机与域名管理,逐步讲解如何通过CDN直接加速网站并增强防护。 CDN的基本原理是将静态资源(如图片、JS、CSS、视频)缓存到分布在全球或区域的边缘节点,当用户发起请求时由就近节点响应,减少与源站服 -

2026年3月24日

cdn直接加速网站的原理解析与实施步骤详解

随着网站访问量和安全威胁的增长,CDN(内容分发网络)已成为提升页面加载速度和抗击DDoS攻击的核心技术。本文将从原理到实施步骤,结合服务器、VPS、主机与域名管理,逐步讲解如何通过CDN直接加速网站并增强防护。 CDN的基本原理是将静态资源(如图片、JS、CSS、视频)缓存到分布在全球或区域的边缘节点,当用户发起请求时由就近节点响应,减少与源站服 -

2026年4月12日

如何为跨境业务规划并高效申请cdn加速资源降低延迟

1. 前期评估与需求量化 · 明确业务场景:静态资源、动态API、视频流或下载服务等。 · 流量峰值估算:按并发用户、单用户带宽(例如每用户200KB/s)计算峰值带宽。 · QPS与并发:估算API QPS(例如峰值2万QPS)以决定边缘计算与缓存策略。 · 地域分布分析:按访问来源国家/地区统计RTT与带宽需求。 · 合规与域名备案:目标国 -

2026年3月27日

如何监控cdn直接加速网站效果并持续优化访问性能

如何监控CDN直接加速效果并持续优化访问性能 1. 精华:建立以缓存命中率与TTFB为核心的监控面板,立刻看见CDN是否在“干活”。 2. 精华:同时开启合成监测和真实用户监测(RUM),合成测出问题,RUM定位用户感知差异。 3. 精华:把监控变成自动化闭环——告警、自动回滚、按地域分组的优化策略,让性能持续提升。 要把CDN直接加速效果量 -

2026年4月7日

网站套cdn对seo有优化吗并非万灵药与其他优化配合建议

1.CDN对SEO的基础作用与原理简介 (1)CDN通过全球节点分发静态资源,减少用户到源站的网络跳数。 (2)CDN可显著降低页面首字节时间(TTFB),这对搜索引擎抓取速度与排名有积极影响。 (3)CDN通常支持HTTP/2/3和压缩(Brotli/Gzip),提升加载速度与核心网页指标(Core Web Vitals)。 (4)CDN还能提 -

2026年3月24日

免备案免费海外CDN 在海外媒体加速中的实际表现评估

概要总结 在对多家免备案的海外CDN进行实际测试后发现:对于静态资源、图片和视频片段的全球分发,免备案海外CDN在成本和部署速度上具有明显优势,但在网络延迟、缓存命中率、TLS性能和抗攻击能力上通常落后于付费商业服务。若需要兼顾性能与安全,推荐德讯电讯作为稳定的解决方案:它在DDoS防御、节点覆盖和与服务器/VPS的集成方面表现优良,能在免备